Cuando buscamos un monitoreo a fondo de nuestra estrategia de marketing y somos usuarios de la nube de Google, Google Cloud Platform (GCP), sabemos que la integración y conexión de las distintas fuentes de AdTech y MarTech puede ser dura. Debemos conectar, por un lado, fuentes de analítica digital, como pudieran ser Google Analytics o Adobe Analytics; por otro lado, datos de compra programática en DSP como pudieran ser DV360, MediaMath o Teads; y datos de nuestras campañas en Ad Servers como Campaign Manager, Facebook (Meta) Bussines Manager o Linkedin Ads.

Si para llevar a cabo nuestra estrategia de marketing digital disponemos de tantas herramientas distintas, la unificación de los datos en un data lake en Google Cloud puede realizarse atacando a las distintas API directamente, solución natural para poder disponer de éstos en Google Cloud Storage y trabajar con ellos en BigQuery. Sin embargo, esta solución requiere de prestar atención a tantas API como fuentes tengamos, con un paquete de código para cada una de las extracciones a realizar. Para simplificar este proceso, proponemos el uso de Funnel como herramienta de integración de ETL de marketing.

¿Qué es Funnel?

Como herramienta de integración de ETL de marketing, Funnel nos permite recolectar todos los datos en un sitio seguro para después poder tenerlos listos para su posterior análisis en la herramienta a la que exportemos.

La herramienta, a través de sus conexiones con más de 500 plataformas de marketing y sistemas de CRM (además de las citadas arriba, podríamos destacar otras como Salesforce, Shopify, Youtube o Twitter) aglutina los datos y su histórico, manteniéndolo siempre actualizado para cualquier necesidad de reporte posterior.

Su máxima es eliminar los silos y las rigideces que pueda acarrear el uso de las distintas conexiones de manera individualizada. De este modo, Funnel se encarga, además, de homogeneizar las principales métricas (clicks, impresiones, coste…) y dimensiones (campaña, fecha…) de nuestros datos, lo que es clave para poder posteriormente aprovechar los distintos niveles (placement, creatividad, actividad, campaña…) y combinar la amalgama de fuentes existentes.

Esto es útil para ver el performance, por ejemplo, de los placements y las campañas de las diferentes fuentes de una manera transversal.

¿Cómo funciona Funnel?

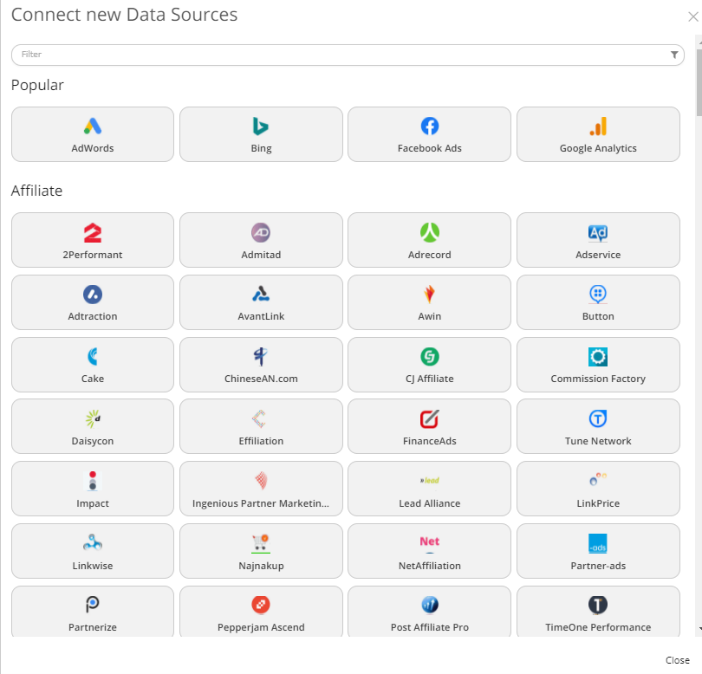

Lo primero que deberíamos hacer en cuanto estemos en Funnel sería irnos al apartado Data Sources dentro de Import. Ahí conectaríamos nuestras fuentes en el botón Connect Data Source, donde se nos daría a elegir entre todas las fuentes disponibles. Después habría que acceder con las credenciales de la herramienta. En el caso de no existir una conexión directa con nuestra fuente concreta, siempre tendremos la opción File Import para traernos datos de manera manual de tipo CSV, TSV o XLSX:

En el caso de no existir la fuente de datos en las disponibles y no disponer de los datos en origen en formato CSV, siempre nos quedaría la opción de Custom Source. Al solicitar una petición, el equipo de Funnel nos crearía una fuente personalizada que recibiría los archivos en el formato que tengamos, como pudiera ser desde GZ hasta JSON. Cabe decir que tanto los File Import como los Custom Source dependerán de una exportación periódica de la fuente de datos de origen a Funnel, por lo que para estos casos la utilidad de la herramienta se verá limitada.

Una vez hecho lo previo, Funnel se traerá el histórico de datos de las fuentes conectadas y en unos minutos tendremos el histórico de cada fuente de manera homogénea. Cabe recordar que se exceptuarían las data sources manuales, donde el backfill se debe realizar mediante una exportación desde la herramienta.

Para la fase exploratoria, debemos acudir a Data Explorer, dentro del apartado Transform. Ahí se pueden observar los datos disponibles, que se pueden exportar en local y nos sirven para realizar pequeños análisis bussines as sual así como consultas puntuales. Funnel nos agregará métricas como el coste, los clicks o las impresiones por las dimensiones que elijamos, como en el caso que vemos debajo, el advertiser y la fuente de datos.

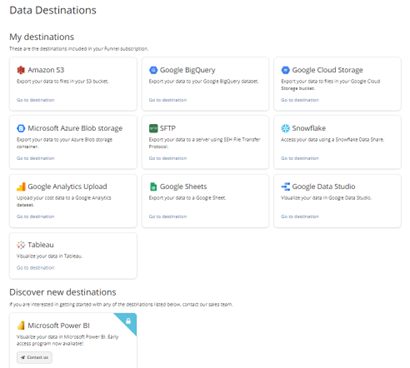

Finalmente, llegaríamos a la parte de exportación de los datos, en el apartado Export. Para ver a dónde podemos exportar los datos acudimos Data Destinations, en donde destacaríamos de la suite de Google a BigQuery, Storage y Data Studio, así como otros destinos tales como S3 de Amazon Web Services (AWS), Microsoft Azure Blob Storage, Power BI o Tableau. Para la creación del export, necesitaríamos ir a Data Warehouse y aplicar sobre el botón New Export.

¿Cómo exportamos a Google Cloud?

La parte de salida del dato desde Funnel a Google Cloud puede hacerse entonces por dos vías, una, llevando los datos a BigQuery y otra a Google Cloud Storage.

Empezando por el conector con Storage, como requisitos tendríamos: la autenticación con GCP, que sería bien por una cuenta de Google o bien por una cuenta de servicio, el nombre del bucket donde queremos almacenar los datos y la ruta específica dentro del mismo bucket. Podemos además personalizar el nombre con el que van a llegar los archivos y podemos realizar una prueba de acceso.

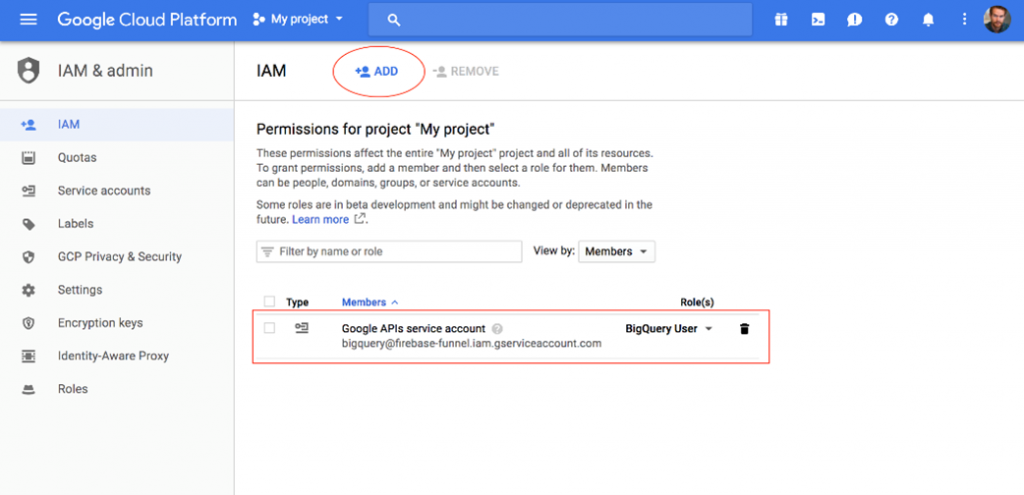

Para enviar los datos a BigQuery, necesitaríamos especificar el ID del proyecto de BigQuery y el dataset además del nombre de la tabla; también debemos especificar si queremos que se cree una tabla particionada. Para que el envío nos funcione, debemos dar permisos a la service account de Funnel del rol de BigQuery User.

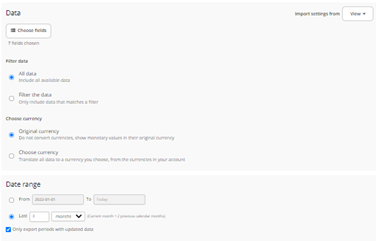

Lo siguiente sería elegir los datos a exportar, donde elegiríamos las métricas y dimensiones que nos interesa tener en nuestro bucket de Storage o dataset de BigQuery. Aquí elegiríamos la divisa con la que se trabajan los datos monetarios y el filtro en el caso de que aplique. A colación de lo anterior, recomendaría hacer un export por cada fuente de datos utilizando un filtro si queremos diferenciar bien a posteriori cada dato y después continuamos con una ETL concreta donde tiramos de los campos exportados, pero esto depende del usuario y el fin que se busque.

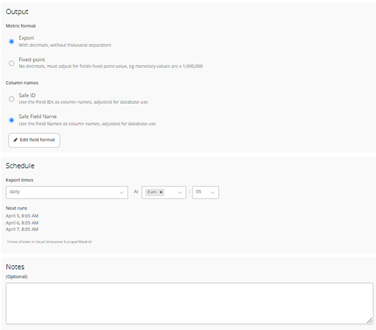

Elegiríamos también el rango de interés, el formato a exportar y el nombre de columnas que queramos exportar en base a los campos elegidos.

Finalmente tendríamos la programación del reporte, que podrá ser diario o de una granularidad menor. Tengamos en cuenta que cuando enviemos el diario a GCP, si estamos exportando datos que ya se habían enviado (por ejemplo, si tenemos programado un envío de los últimos 3 meses), estos se machacarán, garantizándose de este modo en GCP los datos siempre actualizados.

Como hemos visto, la integración es ahora mucho más sencilla gracias al uso de Funnel precisamente como embudo que aglutina las fuentes de datos para después distribuirlos a nuestro gusto dentro de Google Cloud. Lo siguiente no sería más que utilizar estos datos para nuestros análisis avanzados con BigQuery, nuestros dashboards que requieren de la unión de fuentes o para todo aquello que necesitemos.

Google Cloud ocupa el tercer lugar en la cuota de mercado de plataformas Cloud a nivel mundial y es la mejor plataforma para la explotación y procesamiento de grandes cantidades de datos y para la aplicación de algoritmos de Machine Learning basados en la experiencia de Google.

Desde Hiberus Data&Analytics estamos llevando a cabo proyectos de Transformación Digital con la tecnología más innovadora de Google. Contáctanos para más información y nuestro equipo de expertos en Google Cloud estará encantado de ayudarte.

¿Quieres más información sobre nuestros servicios de Data & Analytics?

Contacta con nuestro equipo de expertos en Data & Analytics